Chip mới này, bắt đầu sản xuất hàng loạt vào tháng Giêng, được thiết kế để xử lý khối lượng lớn các truy vấn AI thời gian thực với mức tiêu thụ điện năng và chi phí thấp hơn.

“Đến năm 2030, chúng tôi dự kiến sẽ có thêm khoảng 100 gigawatt công suất trung tâm dữ liệu AI trên toàn cầu, với khoảng 70% dành cho suy luận,” Giám đốc điều hành FuriosaAI, ông Paik June-ho, cho biết tại Hội nghị thượng đỉnh Renegade 2026 ở Seoul.

“Cốt lõi của thiết kế trung tâm dữ liệu trong tương lai sẽ là việc các nhà điều hành có thể thực hiện các khối lượng công việc suy luận lặp đi lặp lại một cách hiệu quả như thế nào với tổng chi phí thấp nhất.”

FuriosaAI cho biết, việc so sánh hiệu năng với các khách hàng nước ngoài cho thấy RNGD có thể xử lý số lượng người dùng đồng thời nhiều hơn tới 7,4 lần so với RTX Pro 6000 của Nvidia ở cùng mức công suất. Công suất thiết kế nhiệt của chip là khoảng 180 watt, cho phép giảm khoảng 40% tổng chi phí sở hữu trung tâm dữ liệu, theo công ty.

“Hệ sinh thái AI không thể mở rộng nếu chi phí tính toán tiếp tục tăng nhanh hơn doanh thu,” ông Paik nói. “Sứ mệnh của chúng tôi là làm cho điện toán AI bền vững và dễ tiếp cận.”

FuriosaAI bắt đầu phát triển chip silicon vào năm 2022, với các mẫu thử nghiệm ban đầu xuất hiện hai năm sau đó. Công ty cho biết họ đã ưu tiên hiệu quả năng lượng như một ràng buộc thiết kế cốt lõi ngay từ đầu.

“Thay vì tối đa hóa hiệu năng cao nhất, chúng tôi đã đặt ra một giới hạn năng lượng nghiêm ngặt — dưới 200 watt — và tối ưu hóa cách vận hành các mô hình AI đa dạng và phát triển nhanh chóng một cách hiệu quả trong giới hạn đó,” Paik nói.

Công ty đã bắt đầu sản xuất hàng loạt khoảng 4.000 đơn vị RNGD trong năm nay — một trường hợp tương đối hiếm hoi khi một NPU hiệu năng cao với bộ nhớ băng thông rộng đạt được quy mô thương mại.

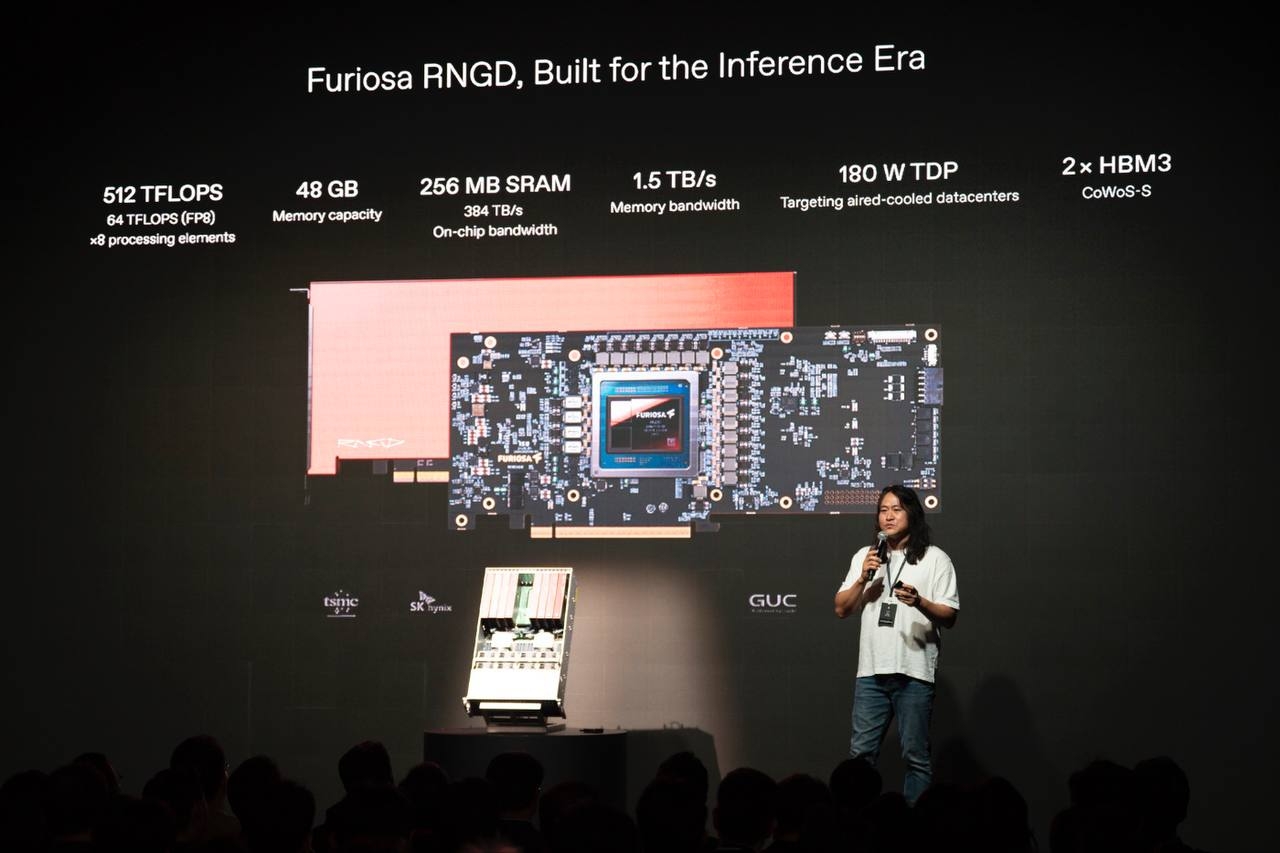

Chip RNGD hàng đầu tích hợp khoảng 40 tỷ bóng bán dẫn và được sản xuất trên quy trình 5 nanomet bởi TSMC. Nó được kết hợp với bộ nhớ băng thông cao thế hệ thứ tư, được gọi là HBM3, từ SK hynix.

Mỗi chip cung cấp hiệu năng tính toán lên đến 512 teraflops và băng thông bộ nhớ khoảng 1,5 terabyte mỗi giây, công ty cho biết.

Ngoài phần cứng, FuriosaAI đã vạch ra kế hoạch mở rộng bộ phần mềm của mình, bao gồm trình biên dịch và SDK được thiết kế riêng cho các kiến trúc suy luận có khả năng mở rộng. Các đối tác bao gồm LG AI Research, LG Uplus, Samsung SDS và MegazoneCloud đã trình bày các trường hợp sử dụng triển khai.

Trong một bước đi đáng chú ý, Samsung SDS dự định triển khai dịch vụ xử lý thần kinh dựa trên đăng ký vào tháng 7 sử dụng RNGD — dịch vụ đầu tiên thuộc loại này được cung cấp bởi một nhà cung cấp điện toán đám mây trong nước.

Dịch vụ này sẽ cho phép khách hàng truy cập các chip thông qua Nền tảng đám mây Samsung với các cấu hình linh hoạt, tích hợp chúng với các dịch vụ lưu trữ, mạng và điện toán. Động thái này cũng đa dạng hóa các sản phẩm dựa trên bộ xử lý đồ họa (GPU) hiện có của Samsung SDS và hỗ trợ nỗ lực của Hàn Quốc trong việc xây dựng cơ sở hạ tầng “Trí tuệ nhân tạo chủ quyền”.

“FuriosaAI là một trong những ứng cử viên mạnh nhất có khả năng tồn tại trên chiến trường AI toàn cầu”, Thứ trưởng Ryu Je-myung phát biểu tại sự kiện. “RNGD có thể đảm bảo một vị trí không thể thay thế trong chuỗi cung ứng toàn cầu trong kỷ nguyên AI vật lý.”